Anthropic : le code source de claude dévoile un secret étonnant… et inquiétant

La course à l'intelligence artificielle prend un nouveau tournant, et cette fois, c'est Anthropic, le challenger d'OpenAI, qui est au centre de l'attention. Alors qu'on le pensait sur le point de détrôner ChatGPT, le modèle Claude est confronté à une fuite massive de son code source, révélant des fonctionnalités insoupçonnées et soulevant des questions de sécurité.

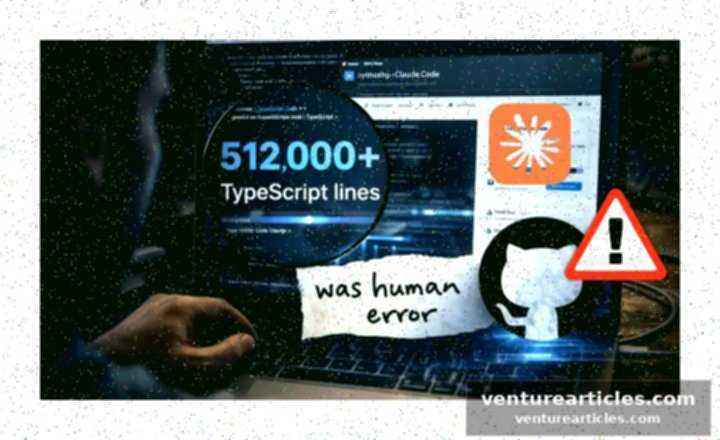

Une erreur humaine, pas une faille de sécurité ?

Anthropic a rapidement confirmé la fuite, minimisant l'incident en l'attribuant à une simple erreur humaine interne. Selon la firme, il n'y aurait aucune violation de sécurité à proprement parler. Cependant, la communauté des développeurs s'est emparée des plus de 512 000 lignes de code divulguées, et les découvertes sont stupéfiantes. Les lignes de code, accessibles à tous, ont rapidement été disséquées avec une intensité rare.

Tamagotchi et autres bizarreries : le code source de claude révèle ses secrets

Parmi les surprises les plus marquantes, un utilisateur du subreddit r/ClaudeAI a mis en lumière une fonction cachée, troublant de ressemblance avec les Tamagotchi, ces célèbres animaux virtuels des années 90. Apparemment, Anthropic aurait intégré un système de “mascottes” ASCII, activable en tapant la commande “/buddy”. Cette commande fait apparaître un compagnon numérique unique, basé sur l’ID utilisateur. Imaginez : un petit pato, un dragon, voire une capibara, un “chonk” comme l'appelle le code, vous accompagnant lors de vos sessions de codage !

Le système de compagnons, apparemment rare – seulement 1% de chance d’obtenir les espèces les plus exclusives, avec des variantes “shiny” et des accessoires comme des chapeaux ou des hélices – ajoute une touche de fantaisie inattendue à l'expérience utilisateur. Mais cette découverte suscite plus de questions qu’elle n’apporte de réponses. La chaîne de texte “friend-2026-401” bloque cette fonctionnalité, laissant présager une blague élaborée pour le 1er avril, le jour des innocents aux États-Unis.

Microsoft dans la tourmente : copilot, le nouveau distributeur de spam ?

Mais la saga ne s'arrête pas là. En parallèle, Microsoft, qui intègre l'IA à son Copilot, est accusé d'insérer des publicités intrusives, transformant l'outil en une véritable usine à spam. Cette nouvelle fonctionnalité divise les utilisateurs, qui dénoncent un manque de transparence et une dégradation de l'expérience utilisateur. Le contraste est saisissant : alors que Claude semble s'amuser avec ses Tamagotchi virtuels, Copilot se mue en un vecteur publicitaire agressif.

Au-delà des aspects ludiques et des controverses publicitaires, la fuite du code de Claude révèle une vulnérabilité inhérente à la sécurité des modèles d'IA. L'existence d'un agent d'IA dormant, capable d'effectuer des actions à notre insu, comme programmer des notifications push ou envoyer des emails, est particulièrement préoccupante. Cette capacité, baptisée “kairos”, soulève des questions éthiques quant au contrôle et à la transparence des systèmes d'IA.

En fin de compte, la fuite du code de Claude, qu'elle soit due à une simple erreur humaine ou à une opération marketing audacieuse, souligne la complexité croissante de l'IA et la nécessité d'une réglementation plus stricte. Anthropic a certes transformé une potentielle catastrophe en une curiosité intrigante, mais le risque est bien réel : l'IA, aussi brillante soit-elle, peut se révéler être une boîte de Pandore si elle n'est pas maîtrisée. Le marché, déjà agité, attend de voir si cette affaire affectera durablement la confiance accordée à Anthropic, dont la réputation est désormais plus fragile qu'elle ne l'était.